Envoyé spécial au Berlin Buzzword 2017, Charly Clairmont nous livre ses premières impressions sur la capitale Allemande et nous parle des bouleversements en cours dans le monde du traitement de la donnée.

Ce week-end ce fut une petite pause berlinoise avant de démarrer Berlin Buzzword 2017 !

S’il fallait commencer par une comparaison facile entre Berlin et le Data Processing, ça serait que tous les deux vivent une évolution effrénée ! Quand on parcourt Berlin, il est possible d’observer de nombreux chantiers pour la construction d’infrastructures importantes : Berlin souhaite certainement prendre toute sa place en tant que capitale ! Disons alors que le data processing en est à ce stade, une course qui a pour but de renouveler les concepts et les solutions tels que nous les connaissons.

Continuer à défendre les valeurs de l’open source

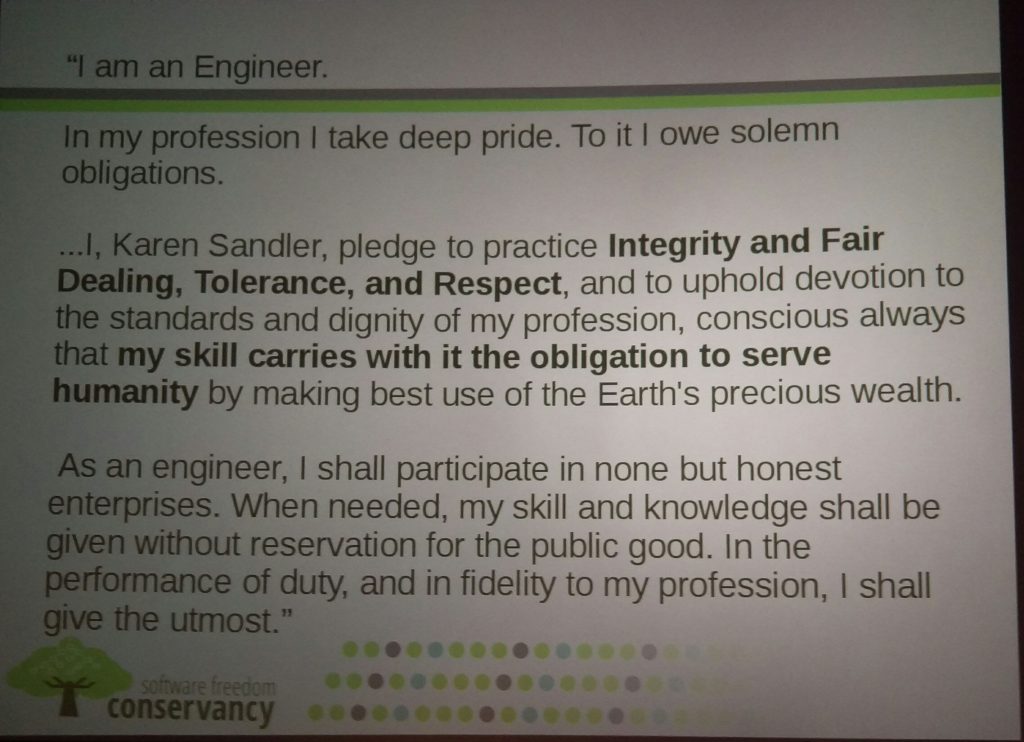

Berlin Buzzword a ouvert avec une keynote de Karen Sandler. Elle a rappelé qu’elle souffrait d’une malformation du cœur, ce qui lui avait valu de se voir poser un pacemaker. Et là, elle a commencé par s’interroger pour savoir si le code source des logiciels dans ce pacemaker était ouvert ! De même, qui a accès aux données stockées et émises par ce pacemaker ? Est-ce que le patient ne devrait pas être celui qui a le mot de passe ?

Certains d’entre nous ont semblé dire que le combat était ailleurs, s’interrogeant pour savoir si Amazon Web Service n’avait pas déjà enterré l’open source ?

Quoi qu’il en soit, Karen Sandler, nous invite à continuer à défendre les valeurs de l’ouverture et la transparence pour avoir un meilleur contrôle de nos données.

Pour revenir à l’ensemble des changements que vit le data processing, tels que le rappelait Michael Häusler de ResearchGate, les traitements batchs sur les technologies distribuées comme Hadoop ont atteint une maturité et c’est pour cela que l’on peut aujourd’hui diffuser les bonnes pratiques et éviter aux nouveaux venus de partir de zéro. L’intervention de Michael Häusler distinguait comment faciliter la vie d’une communauté de développeurs du monde scientifique quand, en même temps, il est question d’opérer simplement et efficacement le cluster de machines. Exactement les questions que se posent les directions informatiques et métiers qui se demandent toutes comment s’en sortir avec ce nouveau machin qu’imposent les nouveaux besoins et leurs dirigeants. J’ai trouvé remarquable son néologisme : « Lakehouse » une contraction de Data Lake et de Data Warehouse qui possède les avantages des deux approches.

En effet, si le schéma à la lecture simplifie l’écriture des données, le fait que le schéma soit déjà associé à l’interrogation sans avoir à le redéfinir à chaque interrogation est un plus. D’où l’intérêt d’exploiter Avro + ORC File (ou Parquet). Le registre de schémas prend alors toute son importance.

Les nombreux bouleversements du data processing

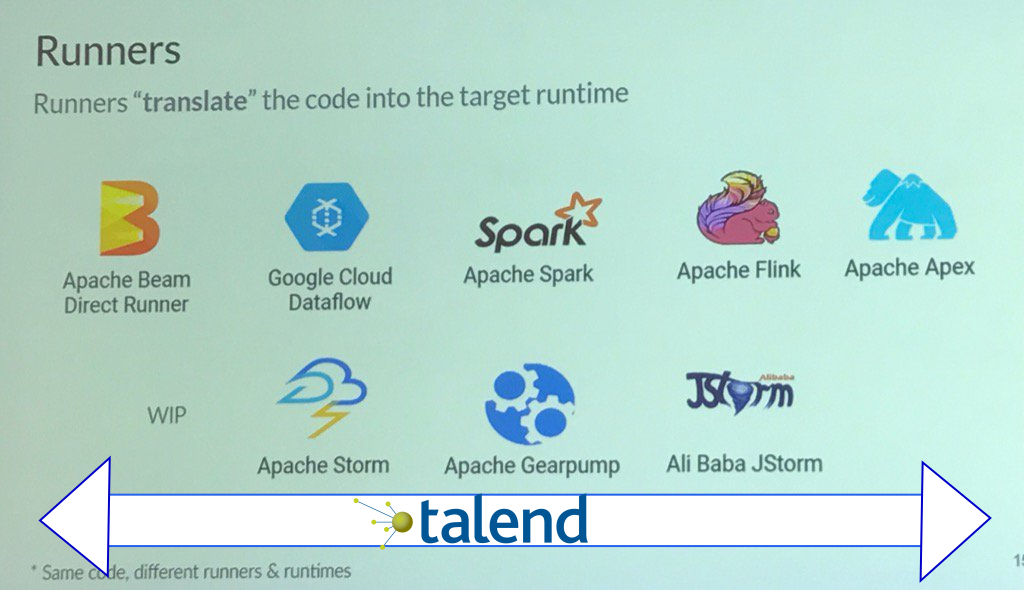

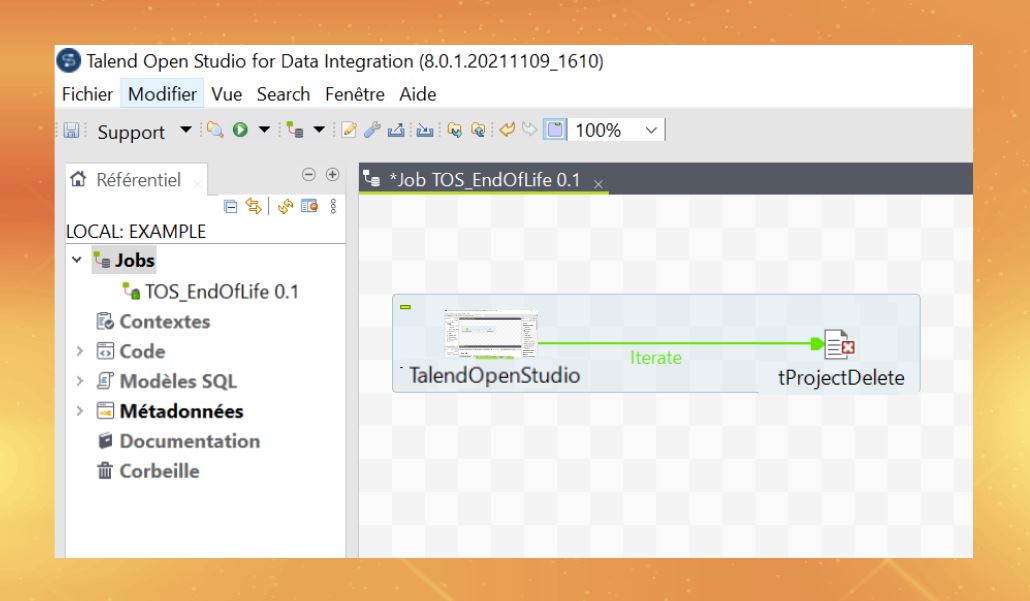

Toujours parmi les bouleversements du traitement de données, Talend fait évoluer sa solution pour embrasser de plus en plus Apache Beam ! L’idée : écrire une et une seule fois son job et l’exécuter partout !

C’est notamment pour ça que Talend a contribué à Apache Beam pour ajouter un outil de benchmark : Nexmark.

John Hugg, de VoltDB, a conclu sa session en nous rappelant que l’écosystème de ces nouvelles technologies était tellement large, que bâtir sa solution nécessitait de bien en comprendre les besoins en amont pour choisir les composants qui y répondent le mieux ! Cela préfigure aussi que chacune de ces librairies, ou chacun de ces projets trouvent leur place, leur audience, leur clients, leurs sponsors ! Que la diversité devrait continuer encore avant que des standards ne s’imposent !

Apache au cœur des discussions

Data Artisans, le premiers contributeur d’Apache Flink, a expliqué les nombreux cas d’utilisation de cette solution. Et de rajouter que depuis la version 1.3 les performances et la stabilité sont encore plus au rendez-vous ! L’état des traitements est persisté via RockDB en effectuant des vérifications fréquentes et incrémentales.

Nous en restons là pour aujourd’hui !

Chuuuut ! Demain, il apparaît que Confluent pourrait nous annoncer l’introduction de la traçabilité de traitements (Data Lineage) dans Apache Kafka Stream ! Apache Kafka s’émanciperait alors de plus en plus de l’écosystème qui l’a vu naître pour devenir une plateforme à part entière !

Charly Clairmont

Sections commentaires non disponible.